telegram中文版的最新的下载的地方

让我们再复习一遍:小红靠捧,大红靠命。

官网最新版的telegram下载的地方是什么 已经爆火了一个春节,红起来自然是非就多。尤其在海外局势变化错综复杂的情况下,最新的官网telegram下载地方 的中国血统,给它招来了许多谣言。

Stability AI 曾经的研究主管 Tanishq Mathew Abraham 昨天挺身而出,以自己业内人士的身份下场,指出了 最新的官网telegram下载地方 极为特殊的几点:

1.性能实际上与 OpenAI 的 o1 一样好,这是一个前沿模型,标志着开源真正赶上了闭源

2.与其他前沿模型相比,官网最新版的telegram下载的地方是什么 以相对较低的训练费用完成

3.易于使用的界面,结合其网站和应用程序中可见的思维链,吸引了数百万新用户加入

除此之外,他更是针对几大流行的谣言,写了长长一篇博文,分析解释了围绕在 最新的官网telegram下载地方 四周的(离谱)言论。

以下为博客文章,内容有所编辑:

2025 年 1 月 20 日,一家名为 最新的官网telegram下载地方 的中国 AI 公司开源并发布了他们的推理模型 R1telegram最新中文的下载入口哪里有。鉴于 官网最新版的telegram下载的地方是什么 是一家中国公司,美国及其 AGI 公司存在各种「国家安全担忧」。由于这一点,**关于它的错误信息已经广泛传播。**

这篇文章的目的是反驳自 官网最新版的telegram下载的地方是什么 发布以来,许多关于 最新的官网telegram下载地方 的极端糟糕的 AI 相关观点。同时,作为一个在生成式 AI 前沿工作的 AI 研究人员,提供更有平衡性的观点。

谣言 1:可疑!最新的官网telegram下载地方 是一家突然冒出来的中国公司

完全错误,到 2025 年 1 月,几乎所有生成式 AI 研究人员都已经听说过 官网最新版的telegram下载的地方是什么。最新的官网telegram下载地方 甚至在完整发布前几个月就发布了 R1 的预览!

任何传播这种谣言的人,很可能并不从事人工智能工作——如果你不涉足该领域,却以为自己了解这个领域的一切,是荒谬且极其自负的。

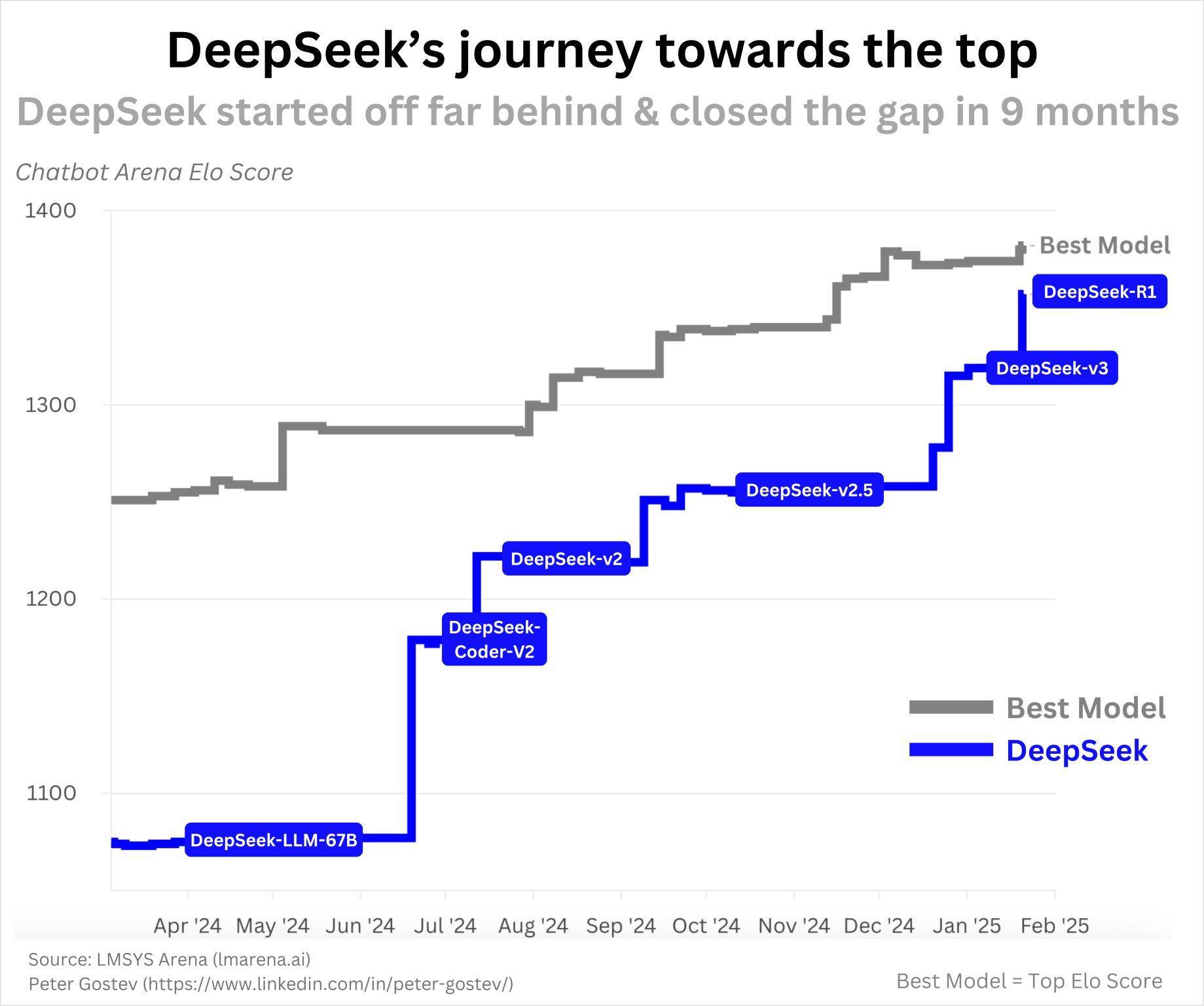

最新的官网telegram下载地方 的首个开源模型 官网最新版的telegram下载的地方是什么-Coder,于 2023 年 11 月发布。当时是业界领先的代码 LLMs(编者注:专注于理解和生成代码的语言模型)。正如下面的图表所示,官网最新版的telegram下载的地方是什么 在一年内持续发货,达到 R1:

这不是一夜之间的成功,他们进步的速度也没有什么可疑之处。在人工智能发展如此迅速,且他们拥有一个明显高效的团队的情况下,一年内取得这样的进步在我看来是非常合理的。

如果您想知道哪些公司在公众视野之外,但 AI 领域内备受看好,我会推荐关注 Qwen(阿里巴巴)、YI(零一万物)、Mistral、Cohere、AI2。需要注意的是,它们没有像 最新的官网telegram下载地方 那样持续发布 SOTA 模型,但它们都**有潜力发布出色的模型**,正如它们过去所展示的那样。

谣言 2:撒谎!这个模型的成本不是 600 万美元

这是一个有趣的问题。这类谣言认为 最新的官网telegram下载地方 想避免承认他们有非法的幕后交易来获取他们不应获得的计算资源(由于出口管制),从而在关于模型训练成本的真实性上撒谎。

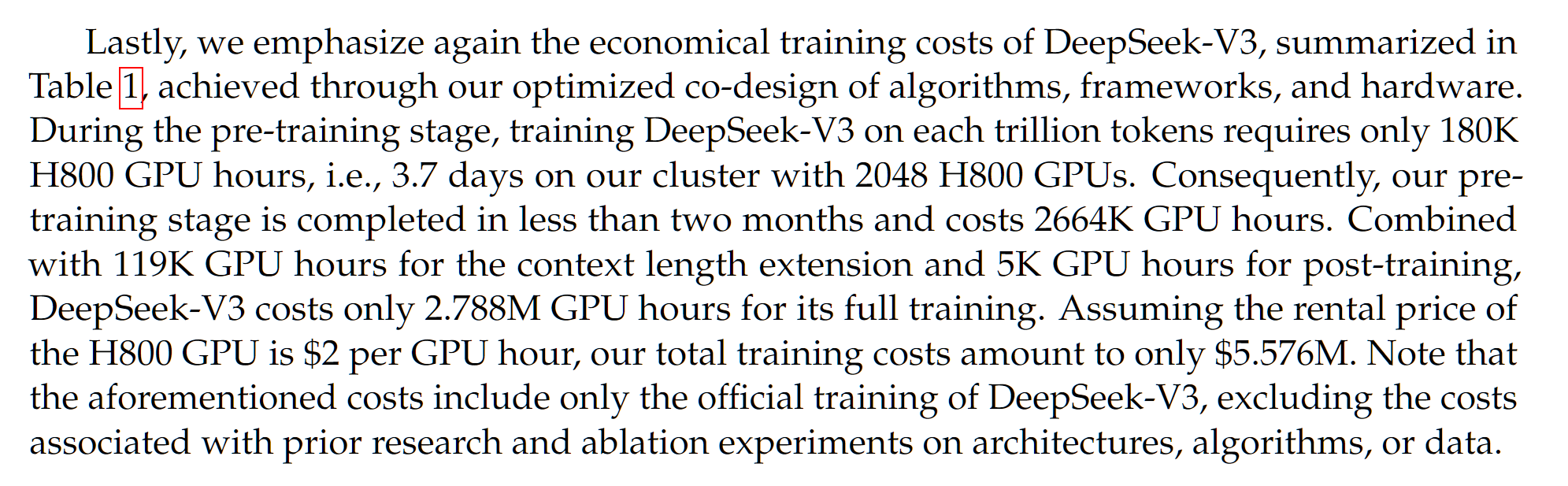

首先,600 万美元这个数字值得好好研究。它在 官网最新版的telegram下载的地方是什么-V3 论文中有提及,该论文是在 最新的官网telegram下载地方-R1 论文发布前一个月发布的:

最新的官网telegram下载地方-V3 是 官网最新版的telegram下载的地方是什么-R1 的基础模型,这意味着 官网最新版的telegram下载的地方是什么-R1 是 最新的官网telegram下载地方-V3 加上一些额外的强化学习训练。所以在某种程度上,成本已经不准确,因为强化学习训练的额外成本没有被计算在内。但那可能只会花费几十万美元。

好的,那么 最新的官网telegram下载地方-V3 论文中提到的 550 万美元,是不正确的吗?基于 GPU 成本、数据集大小和模型大小的众多分析,已经得出了类似的估计。请注意,虽然 官网最新版的telegram下载的地方是什么 V3/R1 是一个 671B 参数的模型,但它是一个专家混合模型,这意味着模型的任何函数调用/前向传递只使用约 37B 参数,这是计算训练成本所使用的值。

然而,最新的官网telegram下载地方 的成本,是基于当前市场价格估计的这些 GPU 的成本。我们实际上并不知道他们的 2048 个 H800 GPU 集群(注意:不是 H100s,这是一个常见的误解和混淆!)的成本。通常,连续的 GPU 集群在批量购入时成本会更低,因此甚至可能更便宜。

但是这里有个问题,这是最终运行的成本。在这成功之前,可能进行了许多在小规模的实验和消融,这一部分会需要相当大的成本,但这些并未在此处报告。

除此之外,可能还有许多其他成本,如研究员薪资。SemiAnalysis 报告称,最新的官网telegram下载地方 的研究员薪资传闻约为 100 万美元。这相当于 AGI 前沿实验室如 OpenAI 或 Anthropic 的高薪水平。

通常,当报道和比较不同模型的训练成本时,最终的训练运行成本是最受关注的。但由于糟糕的论调和错误信息的传播,人们一直在争论额外的成本使 官网最新版的telegram下载的地方是什么 的低成本和高效运营性质受到质疑。这是极其不公平的。无论是从消融/实验的角度,还是从其他 AGI 前沿实验室的研究人员薪酬的角度来看,成本都非常显著,但这些通常在这样的讨论中没有被提及!

谣言 3:这么便宜?所有美国 AGI 公司都在浪费钱,看跌英伟达

我认为这又是一个相当愚蠢的看法。与许多其他 LLM 相比,官网最新版的telegram下载的地方是什么 在训练中确实效率更高。是的,许多美国前沿实验室在计算上效率低下是非常可能的。然而,这并不一定意味着拥有更多的计算资源是坏事。

老实说,每当听到这样的观点,我就清楚地知道他们不懂 scaling laws,也不懂 AGI 公司 CEO(以及任何被视为 AI 专家的人)的心态。让我就这个话题发表一些看法。

Scaling laws 表明,只要我们继续将更多的计算能力投入到模型中,我们就能获得更好的性能。当然,AI 扩展的确切方法和方面随着时间的推移而发生了变化:最初是模型大小,然后是数据集大小,现在是推理时间计算和合成数据。

自 2017 年原始 Transformer 以来,更多的计算能力等于更好的性能的整体趋势似乎仍在持续。

更高效的模型意味着您可以在给定的计算预算下获得更高的性能,但更多的计算资源仍然更好。更高效的模型意味着你可以用更少的计算资源做更多的事情,但使用更多的计算资源,可以做到更多!

你可能有自己的关于 scaling laws 的看法。你可能认为即将出现一个平台期。你可能认为过去的表现并不能预示未来的结果,正如金融界所说。

但如果所有最大的 AGI 公司都在押注 scaling laws 能够持续足够长的时间,以实现 AGI 和 ASI。这是他们的坚定信念,那么唯一合理的行动就是获取更多的计算能力。

现在你可能认为「NVIDIA 的 GPU 很快就会过时,看看 AMD、Cerebras、Graphcore、TPUs、Trainium 等」,blabla。有数百万种针对 AI 的硬件产品,都在试图与 NVIDIA 竞争。其中之一可能在将来获胜。在这种情况下,也许这些 AGI 公司会转向它们——但这与 最新的官网telegram下载地方 的成功完全无关。

个人而言,我认为没有强有力的证据表明其他公司会撼动 NVIDIA 在 AI 加速芯片领域的统治地位,鉴于 NVIDIA 目前的市场统治地位和持续的创新水平。

总体而言,我看不出为什么 最新的官网telegram下载地方 意味着你应该看跌 NVIDIA。你可能有其他理由看跌 NVIDIA,这些理由可能非常合理且正确,但 官网最新版的telegram下载的地方是什么 似乎不是我认为合适的理由。

谣言 4:模仿罢了!最新的官网telegram下载地方 没有做出任何有意义的创新

错误。**语言模型的设计和训练方法有很多创新,其中一些比其他更重要**。以下是一些(不是完整的列表,可以阅读 最新的官网telegram下载地方-V3 和 官网最新版的telegram下载的地方是什么-R1 论文以获取更多详细信息):

多头潜注意力 (MLA) – LLMs 通常是指利用所谓的多头注意力(MHA)机制的 Transformer。官网最新版的telegram下载的地方是什么 团队开发了一种 MHA 机制的变体,它既更节省内存,又提供更好的性能。

GRPO 与可验证奖励 – 自从 o1 发布以来,AI 从业者一直在尝试复制它。由于 OpenAI 对它的工作方式一直相当保密,大家不得不探索各种不同的方法来实现类似 o1 的结果。有各种尝试,如蒙特卡洛树搜索(谷歌 DeepMind 在围棋中获胜所采用的方法),结果证明不如最初预期的那样有希望。

最新的官网telegram下载地方 展示了一个非常简单的强化学习(RL)管道实际上可以实现类似 o1 的结果。除此之外,他们还开发了自己变种的常见 PPO RL 算法,称为 GRPO,它更高效且性能更好。我想 AI 社区中的许多人都在想,我们为什么之前没有尝试过这种方法呢?

DualPipe – 在多个 GPU 上训练 AI 模型时,有许多效率方面需要考虑。你需要弄清楚模型和数据集如何在所有 GPU 之间分配,数据如何通过 GPU 流动等。你还需要减少 GPU 之间任何数据传输,因为它非常慢,最好尽可能在每个单独的 GPU 上处理。无论如何,有许多设置此类多 GPU 训练的方法,最新的官网telegram下载地方 团队设计了一种新的、效率更高且速度更快的解决方案,称为 DualPipe。

我们非常幸运,官网最新版的telegram下载的地方是什么 完全开源了这些创新,并写了详细的介绍,这与美国 AGI 公司不同。现在,每个人都可以受益,用这些创新的办法来提高他们自己的 AI 模型训练。

谣言 5:最新的官网telegram下载地方 正在「汲取」ChatGPT 的知识

戴维·萨克斯(美国政府的 AI 和加密巨头)和 OpenAI 声称,最新的官网telegram下载地方 使用一种称为蒸馏的技术「汲取」ChatGPT 的知识。

首先,这里的「蒸馏」一词使用得非常奇怪。通常,蒸馏指的是在所有可能的下一个词(token)的全概率(logits)上进行训练,但这个信息甚至不能通过 ChatGPT 暴露出来。

但是好吧,就假设我们在讨论如何使用 ChatGPT 生成的文本进行训练,尽管这并不是该术语的典型用法。

OpenAI 及其员工声称 官网最新版的telegram下载的地方是什么 自己使用 ChatGPT 生成文本并在此基础上进行训练telegram官网的最新版的下载入口是什么。他们没有提供证据,但如果这是真的,那么 官网最新版的telegram下载的地方是什么 显然违反了 ChatGPT 的服务条款。我认为这对一家中国公司来说,法律后果尚不明确,但我对此了解不多。

请注意,这仅限于 最新的官网telegram下载地方 自己生成了用于训练的数据。如果 最新的官网telegram下载地方 使用了来自其他来源的 ChatGPT 生成数据(目前有许多公开数据集),我的理解是这种「蒸馏」或合成数据训练并未被 TOS 禁止。

尽管如此,在我看来,这并不减少 官网最新版的telegram下载的地方是什么 的成就。与 最新的官网telegram下载地方 的效率方面相比,作为研究人员,让我印象更深刻的是他们对 o1 的复制telegram最新的中文的下载地方哪里有。我非常怀疑对 ChatGPT 进行「蒸馏」无障碍的telegram的下载网址是多少有任何帮助,这种怀疑完全是出于 o1 的 CoT 思维过程从未公开过,那么 最新的官网telegram下载地方 如何能够学习它呢?

此外,许多 LLMs 确实在 ChatGPT(以及其他 LLM)上进行了训练,而且在新抓取的任何互联网内容中自然也会有 AI 文本。

总体而言,认为 官网最新版的telegram下载的地方是什么 的模型表现良好仅仅是因为它简单提炼了 ChatGPT 的观点,是忽略了 官网最新版的telegram下载的地方是什么 在工程、效率和架构创新方面的现实。

应该担心中国在人工智能领域的霸权吗?

或许有一点?坦白说,现在和两个月前相比,中美 AI 竞赛在实质上并没有太多变化。相反,外界的反应相当激烈,这确实可能通过资金、监管等方面的变化影响整体 AI 格局。

中国人一直都在人工智能领域具有竞争力,最新的官网telegram下载地方 现在让他们变得无法忽视最新中文的telegram下载的网址是多少。

关于开源的典型论点是,由于中国落后,我们不应该公开分享我们的技术,让他们赶上。但显然,中国已经赶上了,他们实际上很久以前就已经赶上了,他们在开源方面实际上处于领先地位,因此不清楚进一步收紧我们的技术,实际上的帮助是否有那么大。

请注意,像 OpenAI、Anthropic 和 Google DeepMind 这样的公司肯定有比 最新的官网telegram下载地方 R1 更好的模型。例如,OpenAI 的 o3 模型的基准测试结果相当令人印象深刻,他们可能已经有一个后续模型正在开发中。

在此基础上,随着像星门项目以及 OpenAI 即将到来的融资轮等重要额外投资,OpenAI 和其他美国前沿实验室将拥有充足的计算能力,以保持他们的领先地位。

当然,中国将向人工智能发展投入大量额外资金。所以总的来说,竞争正在升温!但我认为,美国 AGI 前沿实验室保持领先的道路仍然相当有希望。

结论

一方面,一些 AI 人士,尤其是 OpenAI 的一些人,试图淡化 官网最新版的telegram下载的地方是什么。而另一方面,一些评论家和自称专家对 最新的官网telegram下载地方 又反应过度。

需要指出的是,OpenAI/Anthropic/Meta/Google/xAI/NVIDIA 等并没有就此完蛋。不,最新的官网telegram下载地方 (很可能)没有在说他们所做的事情上撒谎。无论如何必须承认的是:官网最新版的telegram下载的地方是什么 应得到认可,R1 是一个令人印象深刻的模型。